Grafana, ведущая платформа мониторинга и аналитики с открытым исходным кодом, экстренно выпустила патч для критической уязвимости безопасности в своем экспериментальном плагине искусственного интеллекта. Эта уязвимость, в случае эксплуатации, могла бы позволить злоумышленникам манипулировать ИИ для эксфильтрации конфиденциальных данных пользователей, включая конфигурации дашбордов и запросы к базам данных, на внешний сервер под их контролем. Этот инцидент высвечивает новый и тревожный вектор атаки, при котором системы искусственного интеллекта становятся каналом для кражи данных с помощью техники, известной как косвенная инъекция промптов.

Уязвимость заключалась в обработке плагином данных, получаемых с внешних URL-адресов. Злоумышленник мог создать вредоносную веб-страницу, содержащую скрытые враждебные инструкции. Когда плагин ИИ Grafana обрабатывал эту страницу — например, для её суммаризации — искусственный интеллект интерпретировал скрытые команды как легитимные промпты. Эти команды могли затем принудить ИИ извлечь конфиденциальную информацию из экземпляра Grafana, такую как данные метрик или конфигурации источников данных, и передать её на указанную злоумышленником конечную точку. Этот метод обходит традиционные периметры безопасности, превращая в оружие внутреннюю функциональность ИИ и его доверие к обрабатываемым данным.

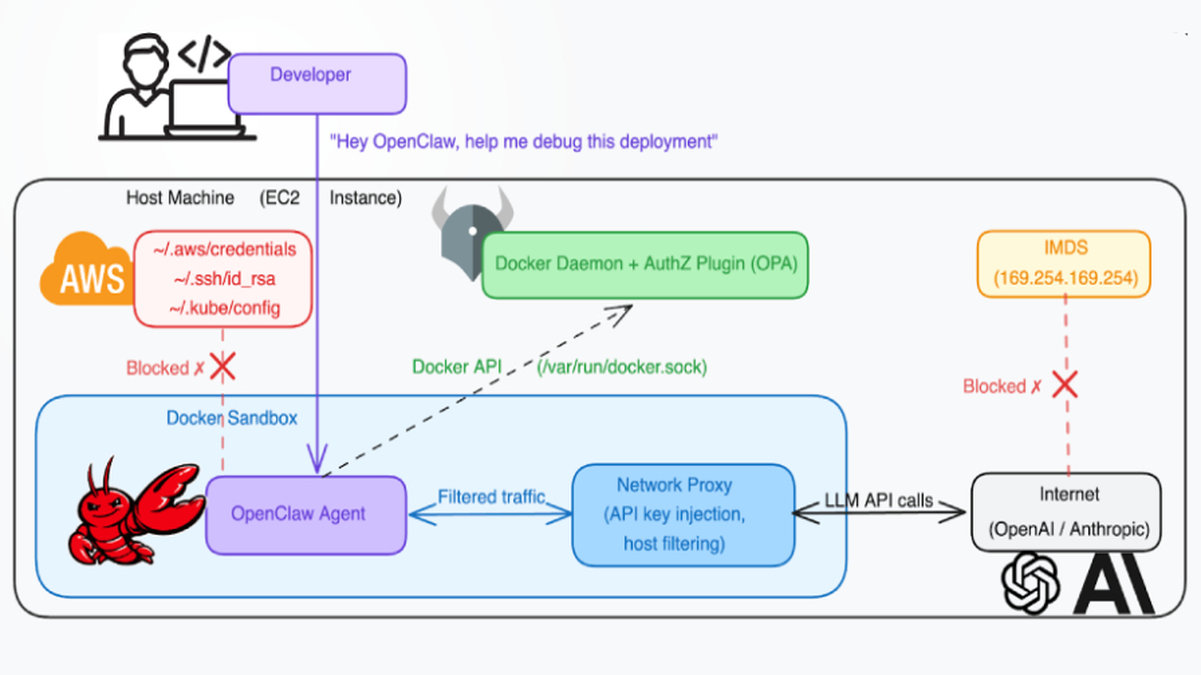

Исследователи безопасности подчеркивают, что данный недостаток представляет собой смену парадигмы в безопасности приложений. В отличие от прямой инъекции промптов, когда вредоносный ввод подается напрямую в чат-интерфейс, этот косвенный метод внедряет атаку внутрь данных, которым ИИ запрограммирован доверять и которые он поглощает автономно. Это подчеркивает фундаментальную проблему защиты приложений, усиленных ИИ: необходимость строгого ограничения способности ИИ выполнять действия, такие как получение и отправка данных, а также отношение ко всему обрабатываемому контенту как к потенциально недоверенному, независимо от его источника.

Оперативное исправление, выпущенное командой Grafana, предотвратило широкомасштабную эксплуатацию, но раскрытие уязвимости служит критическим предупреждением для всей отрасли. Поскольку организации быстро интегрируют генеративный ИИ и большие языковые модели в бизнес-приложения, они должны расширить свои модели угроз. Теперь протоколы безопасности должны учитывать специфические для ИИ риски, включая инъекцию промптов, отравление обучающих данных и злоупотребление агентами ИИ, имеющими доступ к чувствительным системам. Это событие в широко используемой платформе, такой как Grafana, является настоятельным призывом к внедрению надежных фреймворков безопасности ИИ, проведению тщательного аудита интеграций с ИИ и соблюдению принципа наименьших привилегий для любой функциональности на основе ИИ.