Кибербезопасность в эпоху искусственного интеллекта: как уязвимые конечные точки угрожают инфраструктуре больших языковых моделей

Стремительное внедрение больших языковых моделей (LLM) в бизнес-процессы создает новые векторы для кибератак. Эксперты предупреждают, что недостаточно защищенные конечные точки — интерфейсы API, плагины и пользовательские приложения, взаимодействующие с моделями, — становятся критической уязвимостью. Злоумышленники активно ищут эксплойты для этих компонентов, чтобы получить несанкционированный доступ к мощным AI-системам.

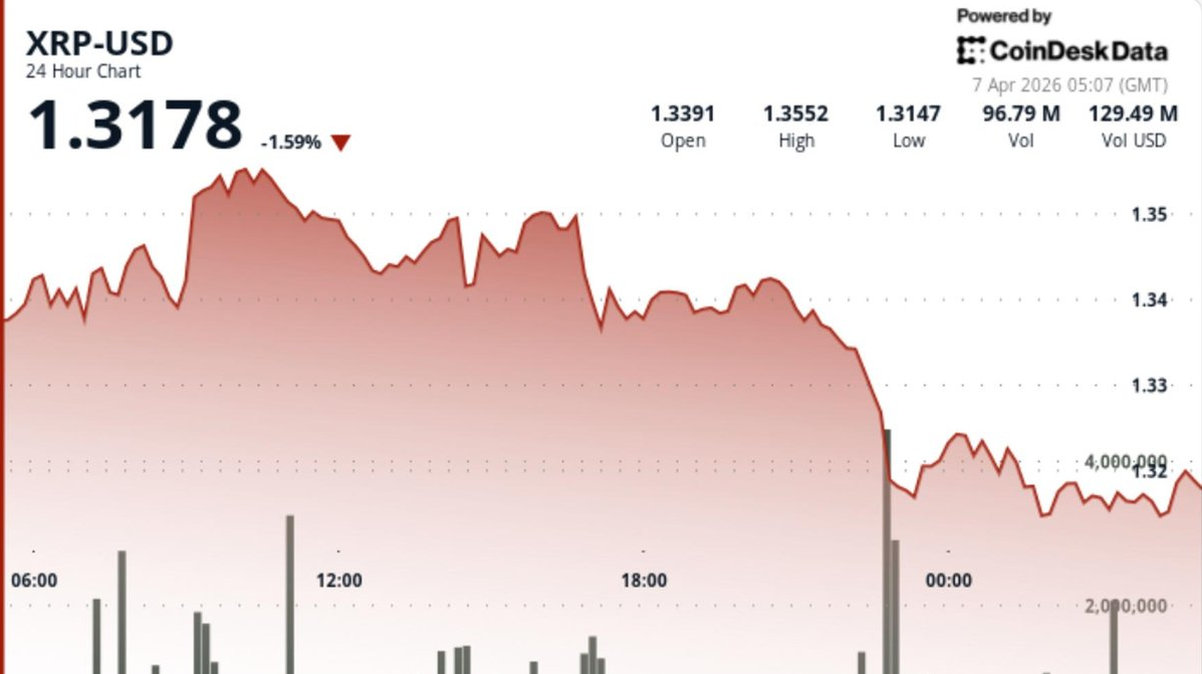

Одной из главных угроз остается вредоносное ПО, включая изощренные атаки типа ransomware. Представьте сценарий, когда через уязвимый плагин в корпоративном чат-боте злоумышленники шифруют базу данных, используемую для обучения модели, и требуют выкуп в крипто. Блокчейн-транзакции в таком случае лишь анонимизируют платеж, делая расследование крайне сложным.

Не менее опасен фишинг, адаптированный под новую реальность. Мошенники создают копии интерфейсов для работы с LLM, выманивая у сотрудников учетные данные. Получив доступ, они могут незаметно похищать конфиденциальные данные, что приводит к масштабной утечке данных. Интеллектуальная собственность, персональная информация клиентов, внутренняя переписка — все это оказывается под угрозой.

Проблема усугубляется тем, что многие компании, стремясь быстрее внедрить инновации, уделяют недостаточно внимания безопасности периметра AI-инфраструктуры. Каждая новая интеграция, каждый внешний сервис, подключенный к модели, расширяет поверхность для потенциальной атаки. Уязвимость в одном, казалось бы, незначительном компоненте может стать лазейкой для компрометации всей системы.

Специалисты по кибербезопасности настаивают на принципе "безопасность по дизайну" при разработке и подключении любых элементов экосистемы LLM. Необходим строгий аудит кода плагинов, мониторинг аномальной активности в API-вызовах и сегментация сетей. Регулярное тестирование на проникновение и обучение сотрудников должны стать обязательной практикой.

Защита инфраструктуры больших языковых моделей — это непрерывный процесс, а не разовая настройка. По мере развития технологий будут появляться и новые угрозы. Компаниям необходимо проактивно выявлять и закрывать уязвимости, особенно на конечных точках взаимодействия, чтобы мощь искусственного интеллекта не обернулась против своих создателей. Инвестиции в комплексную кибербезопасность сегодня — это страховка от катастрофических потерь завтра.