كرست فرق الأمن السيبراني جهودًا كبيرة لبناء أطر إدارة الهوية والوصول للمستخدمين البشريين وحسابات الخدمة. ومع ذلك، ظهرت فئة جديدة من الفاعلين تعمل إلى حد كبير دون رقابة داخل البيئات المؤسسية: وكلاء البرمجة بالذكاء الاصطناعي. يعمل Claude Code من Anthropic الآن على نطاق واسع عبر المنظمات الهندسية، حيث يقرأ الملفات وينفذ أوامر Shell ويستدعي واجهات برمجة التطبيقات الخارجية ويتصل بتكاملات الطرف الثالث المعروفة باسم خوادم MCP، كل ذلك بشكل مستقل. الأهم من ذلك، ينفذ هذه الإجراءات بكامل صلاحيات المطور الذي بدأ تشغيله، ويعمل مباشرة على الجهاز المحلي قبل أن تتمكن أي أداة أمنية تقليدية على مستوى الشبكة من مراقبة نشاطه. وهذا يخلق نقطة عمياء كبيرة، حيث لا يترك Claude Code أي أثر audit trail صُممت البنية التحتية الأمنية التقليدية لتسجيله.

ينبع فجوة الرؤية هذه من القيود المعمارية للأدوات الأمنية الحالية. تقع معظم حلول الأمن المؤسسي - مثل أنظمة SIEM ومراقبي الشبكة وبوابات واجهات برمجة التطبيقات - عند محيط الشبكة. فهي تحلل حركة المرور فقط بعد مغادرتها لنقطة النهاية. بحلول الوقت الذي يتم فيه إنشاء تنبيه، يكون Claude Code قد أكمل إجراءاته بالفعل: فقد تكون الملفات الحساسة قد قُرئت، وتنفذت أوامر Shell، وربما تم تسريب البيانات. يزيد الملف التشغيلي للوكيل من تفاقم هذا التحدي. فهو "يعيش على الأرض"، مستخدمًا أدوات المطور الحالية وصلاحياته بدلاً من نشر ملفاته الثنائية القابلة للتحديد. وتُضمن اتصالاته ضمن استدعاءات النموذج الخارجي القياسية التي تشبه حركة المرور العادية، وينفذ تسلسلات إجراءات معقدة وغير مطلوبة لم يبرمجها أي إنسان صراحة. وبالعمل باستخدام بيانات الاعتماد الموروثة، يمكنه الوصول إلى أنظمة الإنتاج والبيانات الحساسة والأصول الحرجة الأخرى الموجودة على جهاز المطور.

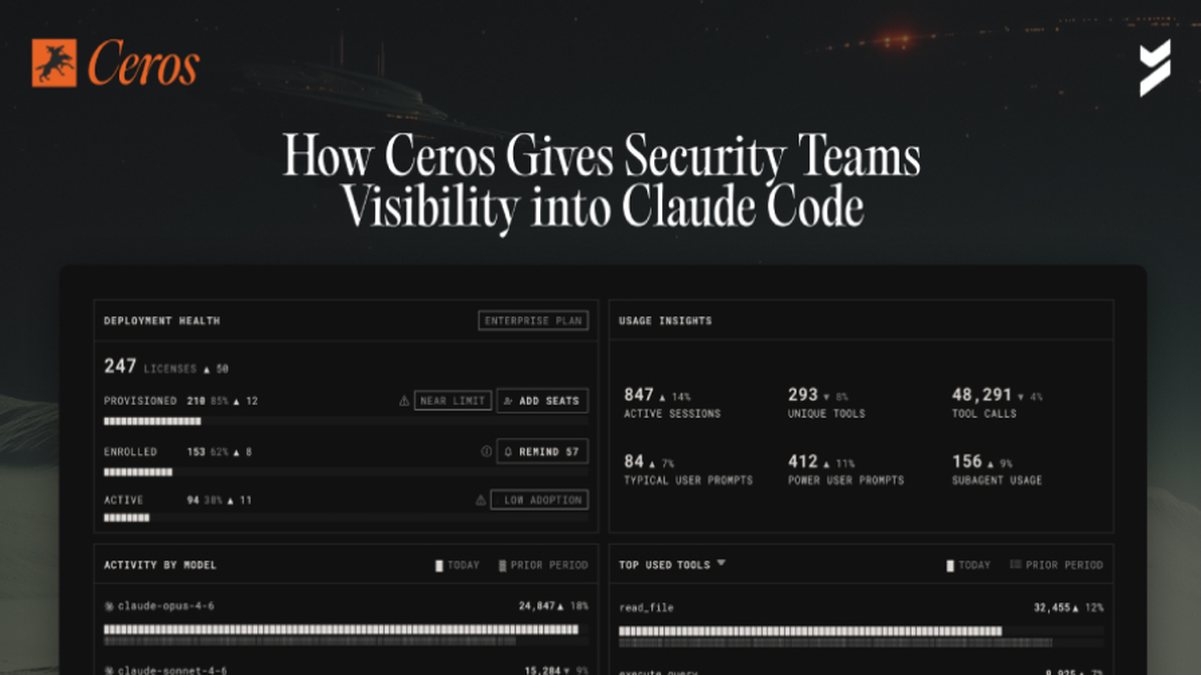

لمعالجة ناقل التهديد الناشئ هذا، طورت Beyond Identity أداة Ceros، وهي طبقة ثقة للذكاء الاصطناعي مصممة لتزويد فرق الأمن بالرؤية والتحكم اللازمين. يتم نشر Ceros مباشرة على محطة عمل المطور بجانب Claude Code. تعمل من خلال إنشاء مراقبة في الوقت الفعلي، وتنفيذ سياسات الأمن أثناء وقت التشغيل، وإنشاء أثر audit trail تشفيري لكل إجراء ينفذه وكيل الذكاء الاصطناعي. تحول هذه المقاربة الأمن إلى اليسار إلى نقطة التنفيذ، مما يتيح الحوكمة قبل انتشار الإجراءات إلى طبقة الشبكة. يهدف الحل إلى إخضاع وكلاء الذكاء الاصطناعي لنفس نموذج الأمن المطبق على الهويات البشرية وهويات الخدمة.

يمثل تنفيذ Ceros خطوة حاسمة نحو دمج الذكاء الاصطناعي بشكل آمن في دورة حياة تطوير البرمجيات. من خلال توفير آلية لفرض السياسات - مثل منع الوصول غير المصرح به إلى الملفات أو تقييد أوامر Shell محددة - يمكن لفرق الأمن التخفيف من المخاطر دون إعاقة إنتاجية المطورين. يضمن أثر audit trail التشفيري المساءلة ويدعم التحقيقات الجنائية، مما ينشئ سجلاً لسلوك وكيل الذكاء الاصطناعي لم يكن موجودًا من قبل. مع انتشار مساعدي البرمجة بالذكاء الاصطناعي، ستكون أدوات مثل Ceros ضرورية للحفاظ على أوضاع الأمن، وضمان أن استقلالية وكلاء الذكاء الاصطناعي لا تأتي على حساب التحكم المؤسسي وحماية البيانات.