تتصاعد المنافسة العالمية في مجال الذكاء الاصطناعي بشكل غير مسبوق، مما يدفع الشركات الرائدة إلى إعادة تقييم أولوياتها الاستراتيجية. وفي تطور مثير للقلق، أفادت تقارير حديثة أن شركتي "أنثروبيك" و"أوبن أيه آي" بدأتا في تخفيف بعض الضمانات واللغة المتعلقة بسلامة النماذج التي تطورها، في سعي محموم لتسريع وتيرة الابتكار والتوسع في السوق. يأتي هذا التحول وسط مخاوف متنامية من أن تسابق الشركات نحو التفوق التكنولوجي قد يأتي على حساب اعتبارات الأمن السيبراني والسلامة الأخلاقية.

ويحذر خبراء الأمن من أن نماذج الذكاء الاصطناعي المتقدمة، إذا لم يتم تطويرها واختبارها بمعايير أمنية صارمة، يمكن أن تصبح أدوات قوية في أيدي الجهات الخبيثة. ومن بين المخاطر المحتملة استخدام هذه النماذج لإنشاء برمجيات خبيثة أكثر تعقيداً وتطوراً، أو لتصميم هجمات تصيّد احتيالية يصعب كشفها. كما يمكن استغلال قدرات الذكاء الاصطناعي في تحليل نقاط الضعف واكتشاف ثغرة أمنية في الأنظمة والبرمجيات بسرعة غير مسبوقة.

وتمثل هجمات فيروسات الفدية أحد أبرز التهديدات التي قد تتفاقم بفضل الذكاء الاصطناعي، حيث يمكن للنماذج اللغوية توليد شيفرات ضارة متطورة أو مساعدة المهاجمين في صياغة رسائل ابتزاز أكثر إقناعاً. علاوة على ذلك، فإن خطر تسريب بيانات حساسة أو سرية قد يزداد إذا تم تدريب نماذج ذكاء اصطناعي على مجموعات بيانات تحتوي على معلومات حساسة دون ضوابط كافية، أو إذا تم استغلال هذه النماذج نفسها للحصول على معلومات ينبغي أن تبقى محمية.

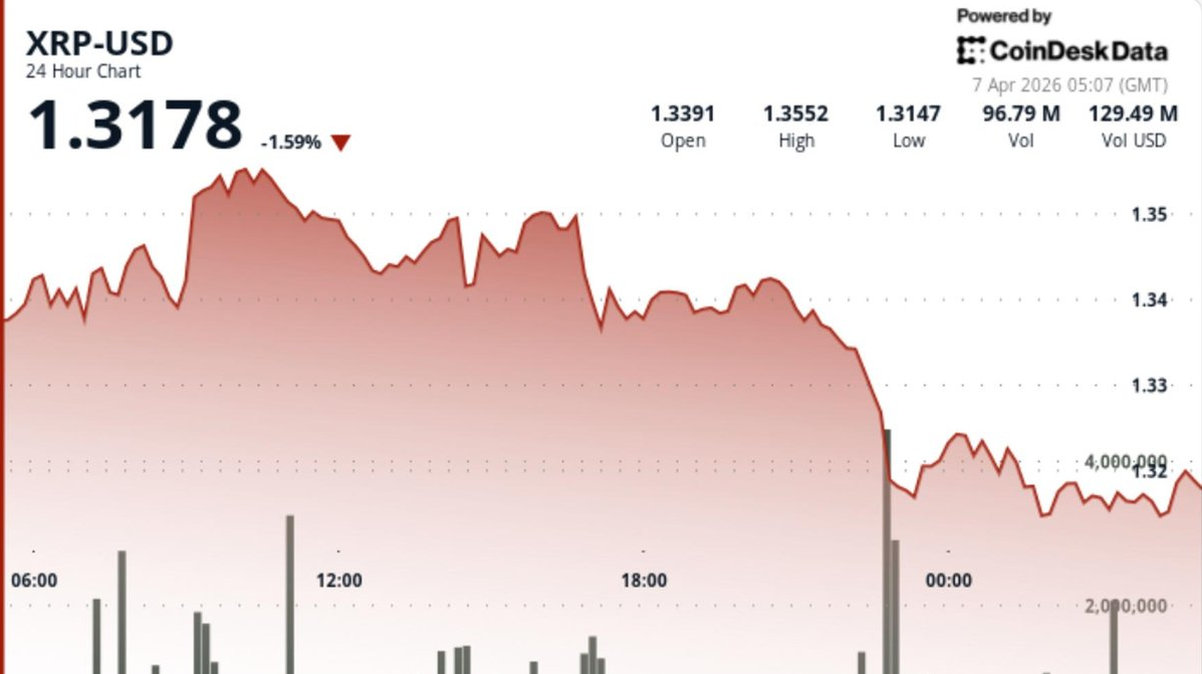

وفي سياق متصل، يشير محللون إلى أن تقنية البلوكشين والعملات الرقمية كريبتو قد تشهد أيضاً تداعيات سلبية محتملة. فمن ناحية، يمكن أن تُستخدم نماذج الذكاء الاصطناعي في شن هجمات أكثر ذكاءً على شبكات البلوكشين أو في استغلال الثغرات في العقود الذكية. ومن ناحية أخرى، فإن أي تهاون في معايير أمان الذكاء الاصطناعي قد يهدد أمن البلوكشين ككل، إذا ما أصبحت هذه النماذج جزءاً من البنية التحتية لإدارة أو مراقبة هذه الشبكات اللامركزية.

وتؤكد هذه التطورات على الحاجة الملحة إلى أطر تنظيمية وقوانين دولية متطورة تواكب التسارع الكبير في سباق الذكاء الاصطناعي. فغياب التشريعات الرادعة والموحدة قد يخلق بيئة خصبة لاستخدام هذه التقنيات الثورية لأغراض ضارة، مما يعرض الأفراد والمؤسسات والدول لمخاطر أمن سيبراني غير مسبوقة.

وفي الختام، بينما يقدم الذكاء الاصطناعي وعوداً هائلة بتطوير مجالات مثل الرعاية الصحية والعلوم، فإن المخاطر المصاحبة لتسارع سباق تطويره دون ضوابط كافية حقيقية وملموسة. إن التوازن بين الابتكار والسلامة، وخاصة في مجالي الأمن السيبراني والأخلاقيات، هو التحدي الأكبر الذي يواجه صناع التكنولوجيا وصانعي السياسات على حد سواء في هذا العصر الجديد.